Gemeinsam lernen, ohne Daten zu teilen

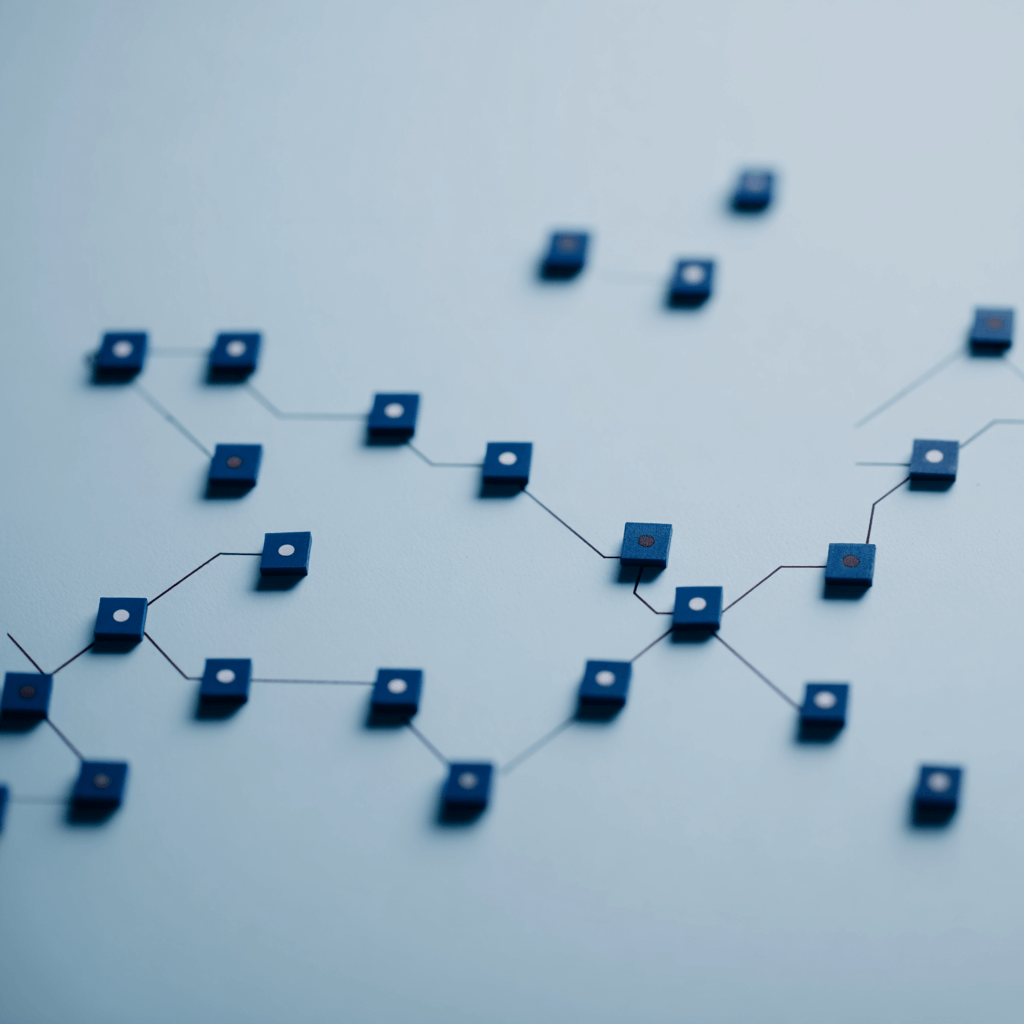

Künstliche Intelligenz lebt von großen Datenmengen. Doch in vielen Branchen dürfen sensible Informationen nicht zentral gesammelt werden. Genau hier setzt ein spezialisiertes Konzept an: Federated Learning. Anstatt Daten an einen zentralen Server zu übertragen, wird das Modell zu den Daten gebracht. Die Trainingsprozesse finden lokal statt, nur die Modell-Updates werden zusammengeführt.

Warum ist dieser Ansatz so interessant?

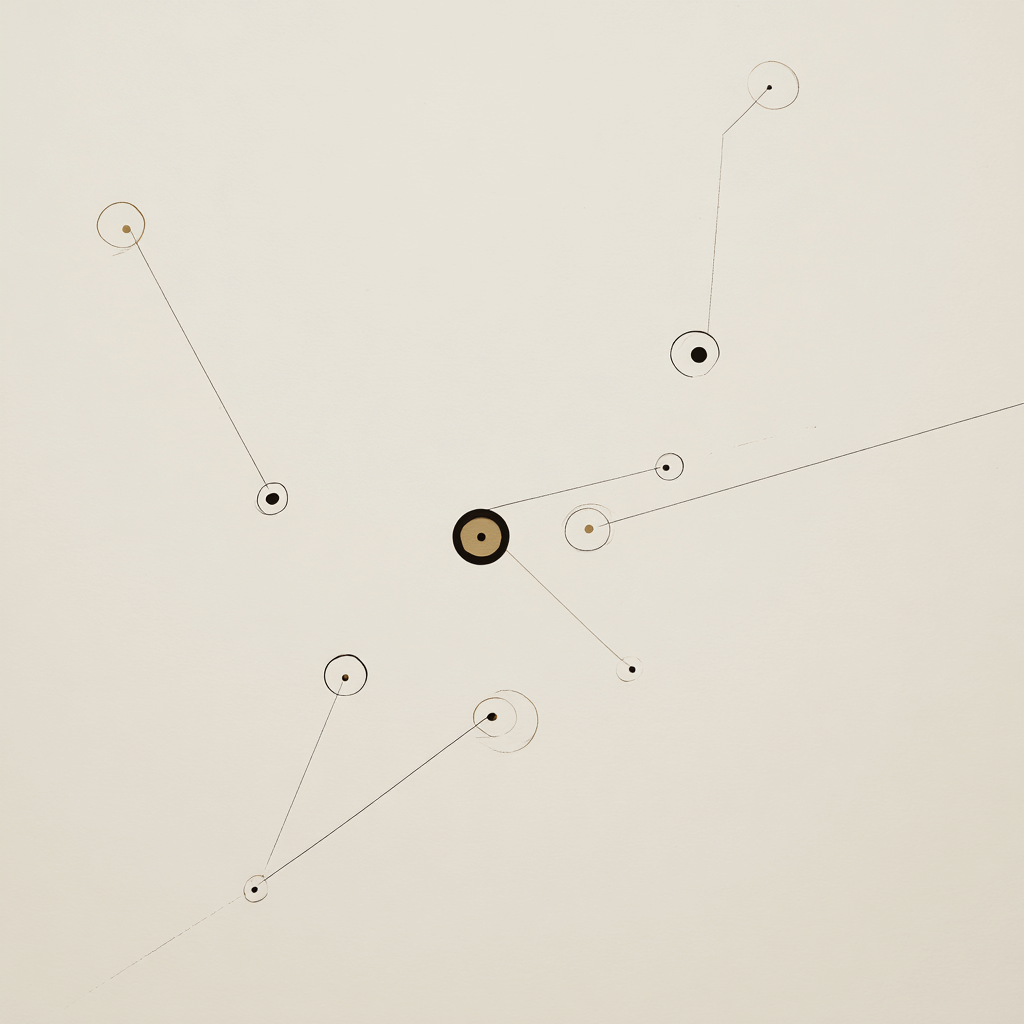

In Bereichen wie Gesundheitswesen, Finanzsektor oder Industrie sind Datenschutz und Geschäftsgeheimnisse entscheidend. Kliniken können beispielsweise KI-Modelle trainieren, ohne Patientendaten außerhalb ihrer Systeme zu speichern. Banken können Betrugsmuster analysieren, ohne interne Kundendaten offenzulegen. Das gemeinsame Lernen erfolgt koordiniert, aber ohne direkten Datenaustausch. Technisch funktioniert Federated Learning über mehrere Trainingsinstanzen. Jede beteiligte Einheit – etwa ein Unternehmen oder ein Gerät – trainiert ein lokales Modell. Anschließend werden lediglich die berechneten Parameter an eine zentrale Instanz übermittelt und dort aggregiert. Das Gesamtmodell verbessert sich iterativ, ohne dass Rohdaten jemals zentral gespeichert werden.

Welche Vorteile ergeben sich daraus?

Neben erhöhter Datensicherheit ermöglicht dieser Ansatz auch dezentrale Skalierung. IoT-Geräte, Smartphones oder Produktionsanlagen können kontinuierlich dazulernen, während sensible Informationen lokal verbleiben. Gleichzeitig reduziert sich das Risiko großer Datenlecks, da keine zentrale Datenbank existiert, die ein attraktives Angriffsziel darstellt. Herausfordernd ist jedoch die technische Koordination. Unterschiedliche Datenqualitäten, Rechenleistungen und Netzwerkbedingungen müssen berücksichtigt werden. Zudem sind robuste Sicherheitsmechanismen notwendig, um Manipulationen einzelner Modell-Updates zu verhindern. Obwohl Federated Learning noch ein spezialisiertes Feld ist, gewinnt es in sicherheitskritischen Branchen zunehmend an Bedeutung. Es verbindet kollaborative Innovation mit strengen Datenschutzanforderungen und eröffnet neue Wege für vertrauenswürdige KI-Entwicklung.